正交箱式超节点是工程优化,更是存量数据中心救星——从技术和市场角度细看曙光scaleX40超节点从技术和市场角度细看曙光scaleX40超节点

中科曙光在中关村论坛期间正式发布了曙光scaleX40超节点,并将其宣传定位为用户“买得起、用得上、用得好”的超节点。从技术角度看,这是正交架构柜内Scale-Up在超节点领域的首个商业化落地;从市场角度看,它可能是在过去忽冷忽热的“一体机”、“整机柜”、“超节点”、“宏机柜”等一众眼花缭乱的概念中杀出的一个现实最优解。

整机柜减半到箱式

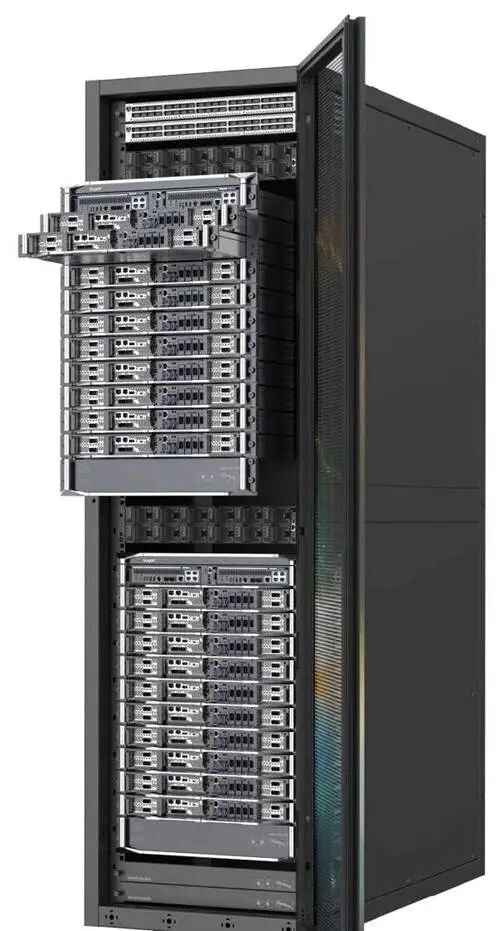

曙光scaleX40采用正交架构将10个计算节点Scale-Up为一个箱式超节点。从正面布局看,超节点上方是2U的电源模块,中间是10个1U的计算节点,下方2U的模块是交换刀片的分液器,估计还承担漏液托盘的功能。一个超节点占用16U空间,对应的电源框占2U,大致占用半个机柜空间。在供电、供冷宽裕的前提下,一个机柜可以部署2个超节点、2组电源框、1台2U的业务交换机。

曙光scaleX40的背面有4块竖直方向安装的交换节点。交换节点每层接口均包含相应计算单元中4颗GPU的Scale-Up链路,由此构成单层全连接网络。计算节点采用风液混合模式冷却,进出液快接头位于节点尾部两侧,与机柜的manifold直接对接。计算节点的供电盲插位于节点尾部中间。交换节点使用液冷,进出液快接头位于节点下方,不与机柜的manifold直接对接,而是由超节点最下方那2U模块再分配。

计算节点配置4颗GPU,位于节点中后部。IO和存储位于节点前部,包括一组E1.S SSD,以及南北向网卡(DPU),还可以选配4块scaleFabric 400Gb高速网卡。整个scaleX40超节点共集成40张GPU,总算力超过28PFLOPS(FP8精度),HBM显存总容量超过5TB,访存总带宽超过80TB/s,Scale-Up聚合带宽超过17TB/s。

正交连接:从热议到商业化

正交架构这个概念已经在业内热议了约一年时间,其根源在于NVIDIA GB200/300 NVL72上市后暴露的痛点:机柜内Scale-Up连接采用大量铜缆,组装复杂、故障率高、运维难度大。NVL72使用的Cartridge(Cable Tray)是一个几乎与机柜等高的部件,铜缆集中在其内部,大家可以自行想象其体积与重量对装卸的挑战,以及维修时的心理阴影。

诚然,GB200带动了“光退铜进”的话题,其实充分肯定了铜在短距内的功耗优势,预计铜仍是未来一段时间柜内Scale-Up的主导。但由大量铜缆构成的Cable Tray显然更像是激进技术验证的权宜之计,而且,未来接口速率进一步提升的话,线缆连接方式带来的插损问题会更为显著,可靠性风险激增。更有效率的方式还是将铜链路尽可能整合到PCB当中——也就是中板、正交卡等。虽然高速PCB存在诸多生产难题克服,但组装、运维的效率优势也很显著。

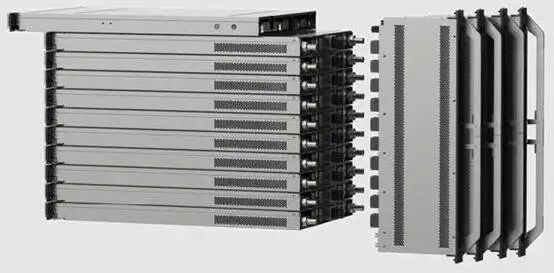

在刚刚结束的GTC 2026当中,Robin Kyber已确定采用中板、无线缆的设计,所需要的组装时间从小时级降为分钟级。Kyber将单柜内的计算节点分为两组,分别连接两块中板,中板的另一面则用交换板连接。中板设计增加了一次转接复杂性,但在72甚至144的GPU数量下,恐怕暂时也只能如此。

相较于中板,正交架构的连接更为简洁。曙光scaleX40是首个商业化的正交架构超节点,其本质便是通过做减法实现了工程实现的再平衡。在2025年,超节点概念爆火,节点规模很快破百。加法盛行之下,“整机柜”这个词已经无法承载超节点的规模,业内甚至产生了“宏机柜”这种概念,试图让大众将超节点继续理解为一个紧耦合的物理整体。曙光scaleX40在规模上选择了减法,也放弃了机柜的概念,而使用了“箱式”这一形容词。一个箱式超节点中的计算节点数量与Kyber一块中板所对应的节点数量大致相当(前者10个,后者9个),也算是英雄所见略同,大致半个机柜的体量,只需要通过4块约一米长的交换刀片即可连接。组装和维护的难度由此变得极低,还可以显著降低故障率。

需要强调的是,曙光scaleX40作为一个工程效率最优的单元,也是可以继续搭积木式的扩展的,包括通过二层组网Scale-Up为百卡级超节点,或通过scaleFabric无损网络Scale-Out为千卡集群。

“半柜”交付,顿显百搭

本文开头提到过,箱式超节点其实就是相当于半个机柜。这规模减半除了获得工程、运维方面的显著优势之外,还极大的降低了部署的门槛。这里说的门槛可不仅仅是采购费用减半这么简单,更包括了对现有机房的适应性。

实际上,NVIDIA一直有NVL32这样的产品线,而且被互联网大厂广泛采用。其中最根本的原因就是NVL32更容易部署到已有的机房当中,通过Sidecar模式为其配套直流供电和液冷CDU。对于没有部署供液管道的机房,需要配套的液冷柜占地会是超节点本身的几倍。在这种机房条件下,部署高密度的整机柜并不会提升整个数据中心的算力密度,算力总量的天花板是供电能力而非技术迭代决定。

除了供电、供冷,还有承重能力的风险。满配的整机柜重量会超过2吨,这对于机房地板是一个巨大挑战,尤其是在国内数据中心惯常使用架空地板的环境下,超重的风险尤甚。对地面进行改造的难度远远高于通过分散部署供电、供冷的难度。新建智算中心的基建标准问题在此略过不表。

因此,从NVL32,到今天的曙光scaleX40,都更适合部署到现有的数据中心当中。传统机房部署AI服务器时,一个机柜只能部署一两台8卡GUP机型的情况比比皆是。这类机房通过代价较低的改造和设备投资,还是有机会部署“半柜”或“箱式”超节点的。

从性能角度看,曙光scaleX40这类普适版超节点的能力上限远非过往的8卡机可比。在DeepSeek爆火之初,智算一体机、推理一体机一度备受追捧,这些一体机大多数本质是4卡、8卡机。但这类一体机的显存容量只能勉强放下DeepSeek 671B类似规模的MoE模型,并没有很充裕的容量用于KV Cache,限制了并发能力和长上下文能力,只能算是可用,但不好用。更致命的问题是,随着MoE模型推理效率的不断优化,专家并行(EP)、DP分离、KV Cache卸载等技术可以显著降低推理成本,这类技术更适合部署在规模较大的Scale-Up集群当中,仅仅具备Scale-Out或负载均衡能力的一体机的投入产出比难以优化,其推理业务竞争力面临从“不好用”退至“无用”的风险——这也是去年下半年一体机概念转冷、超节点概念窜起的根本原因。

曙光scaleX40拥有超过5TB的HBM显存,不但可以轻松部署TB级MoE模型,还预留了很充裕的KV Cache容量,能够满足高吞吐量、长上下文推理。这个量级的硬件规格定义了未来推理算力“有用”、“好用”的标准。考虑到Scale-Up扩展、异构并行的技术潜力,这类箱式超节点还有升级的机会,有利于保护投资。

结语

养龙虾热刺激了Token消耗,也将推理成本的激烈竞争推向舞台中心。曙光scaleX40箱式超节点是当前技术条件下的工程最优单元,也重塑了算力投资逻辑。超节点固然是推理成本最优的解决方案,但如何降低投资门槛、如何适配现有数据中心?轰轰烈烈的加法显然脱离了存量市场的真实需求,而恰到好处的减法才是箱式超节点的魅力所在。这种符合当前推理最佳实践需求的配置单元同时解决了“买得起、用得上、用得好”的基本需求。恰到好处的降门槛得以兼顾传统数据中心与新建智算中心的基础设施条件,对现有数据中心业务升级,或盘活早几年投建的数据中心资产都有积极的意义。